La inteligencia artificial, bajo la lupa: demandas e investigaciones por el uso no autorizado de contenidos protegidos

Las grandes tecnológicas que desarrollan sistemas de IA se enfrentan a una oleada de litigios por haber entrenado sus modelos con libros, artículos periodísticos y obras musicales sin tener licencia para ello.

Bruselas abre otro frente contra Google por el uso de contenidos sin permiso para entrenar su inteligencia artificial

El desarrollo acelerado de la inteligencia artificial generativa tiene al sector tecnológico sumido en una ofensiva legal colosal a ambos lados del Atlántico, con reguladores, legisladores y jueces tratando de seguir el ritmo de una industria que vive casi cada semana una nueva revolución.

A lo largo de este 2025, empresas como Anthropic, Meta, OpenAI, Google y Perplexity han sido objeto de demandas, expedientes e investigaciones por utilizar contenidos protegidos por derechos de autor para entrenar sus modelos de lenguaje, sin contar con autorización de los titulares ni compensarles económicamente.

Los conflictos abarcan obras literarias, contenido periodístico o composiciones musicales, y han derivado en acuerdos multimillonarios, sentencias judiciales y una presión regulatoria creciente que amenaza con transformar el modelo de negocio del sector.

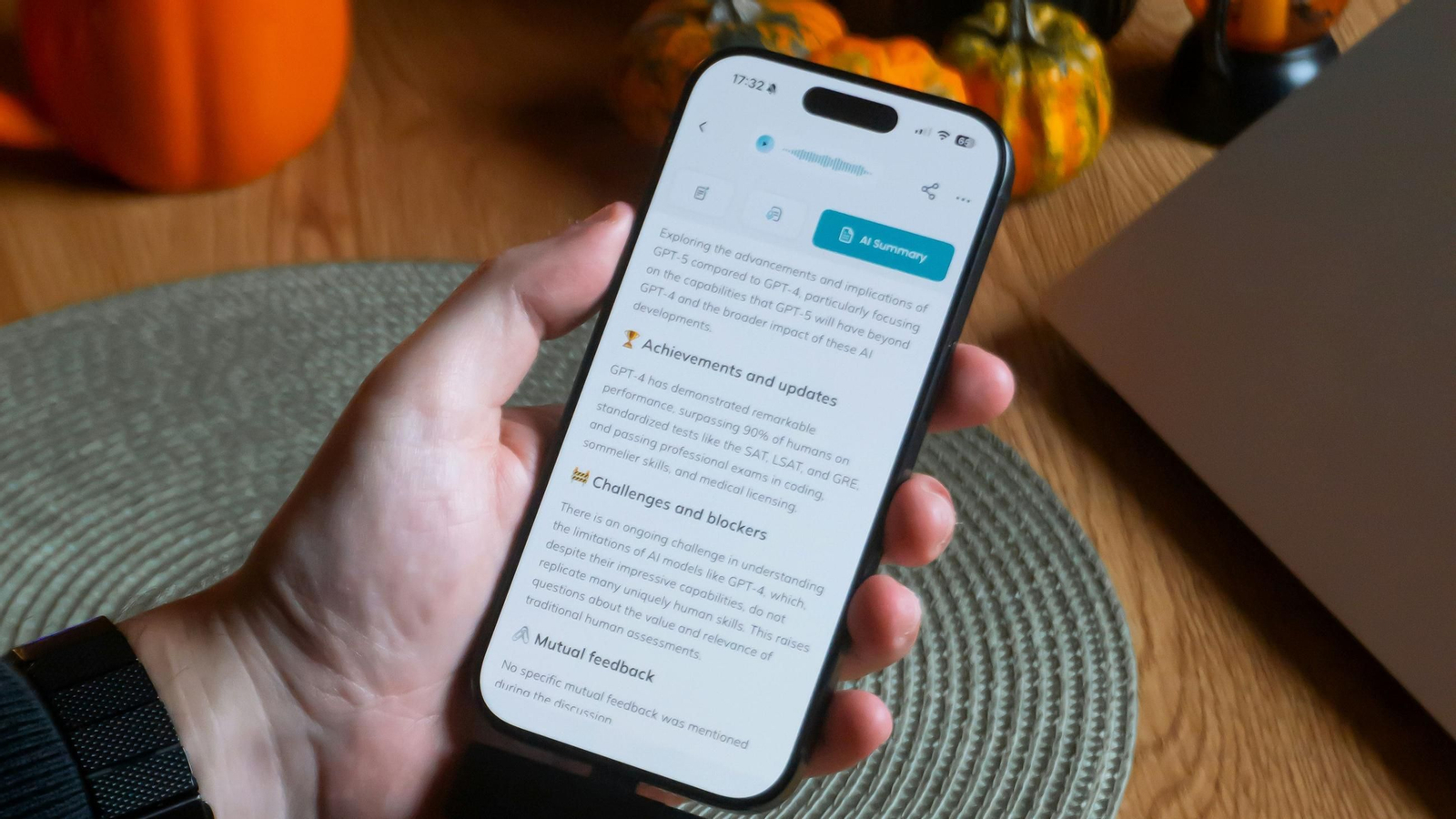

Anthropic: 1.500 millones de dólares para cerrar la mayor demanda por copyright

Quizás el episodio más relevante, tanto por lo abultado de la cifra como por sus posibles repercusiones en el medio y largo plazo, sea el que tuvo como protagonista a Anthropic, responsable del asistente de IA Claude.

En agosto de 2024, un grupo de autores interpuso una demanda colectiva acusando a la compañía de haber utilizado cientos de miles de libros descargados de repositorios piratas. Tras una disputa legal de meses, un juez federal estadounidense dictó el pasado junio una sentencia que daba la razón a los autores, pero con matices.

El tribunal consideró que entrenar modelos de IA con libros adquiridos legalmente podría ampararse en la doctrina del fair use (uso legítimo), una excepción en la legislación estadounidense al copyright que permite ciertos usos de obras protegidas. Sin embargo, el magistrado dejó claro que esa interpretación no se aplicaba cuando los contenidos procedían de fuentes ilícitas.

Esta distinción abrió la vía a una negociación. El pasado 5 de septiembre, Anthropic propuso un acuerdo provisional valorado en 1.500 millones de dólares, el mayor registrado hasta la fecha en litigios relacionados con inteligencia artificial y derechos de autor. El pacto contempla un pago aproximado de 3.000 dólares por obra incluida en un fondo de compensación creado para los autores que acepten participar.

Además, la empresa se comprometió a destruir o excluir de uso comercial las bases de datos pirateadas, aunque no está obligada a eliminar los modelos ya entrenados con ese material.

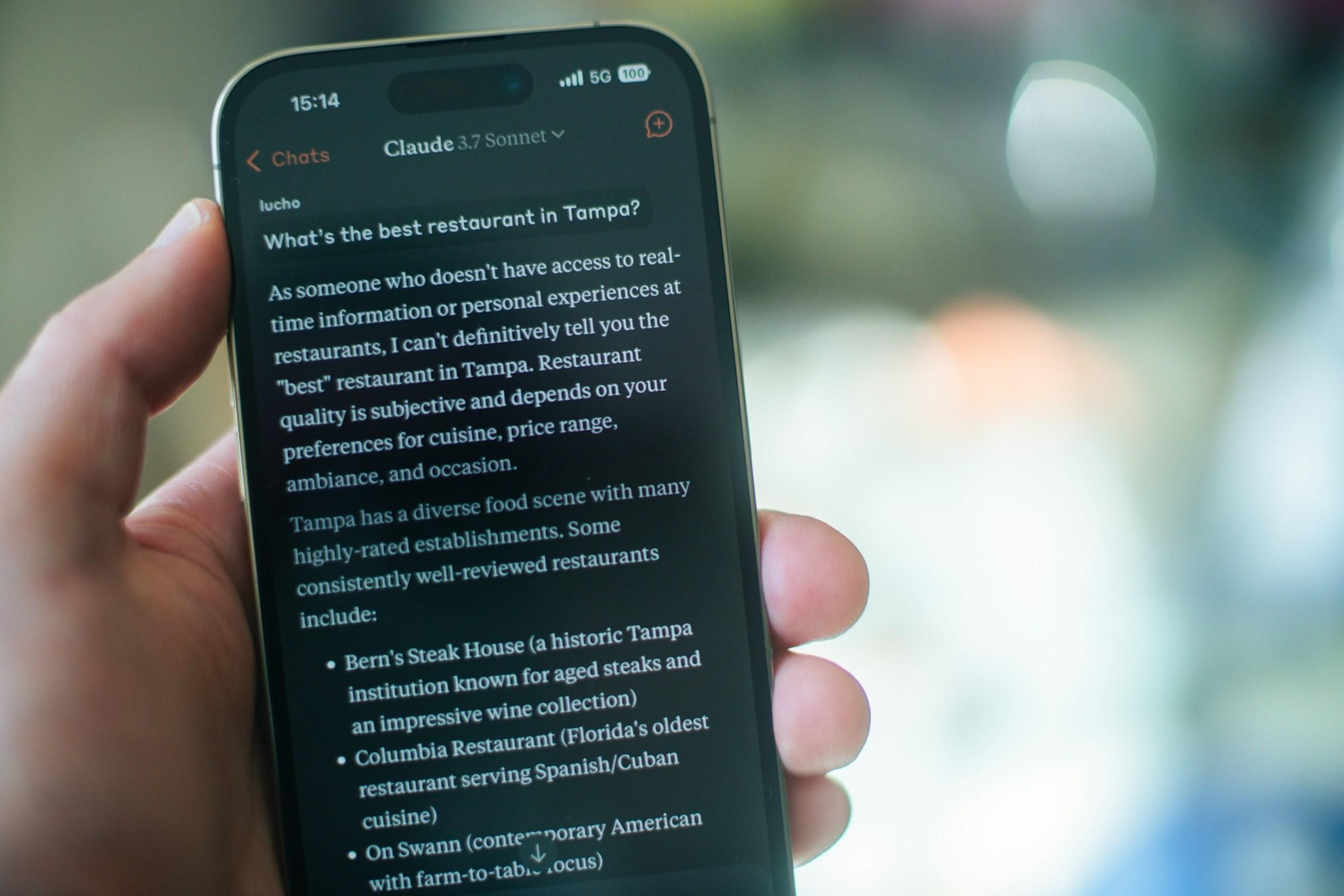

Europa: la sentencia de Múnich contra OpenAI

Mientras en Estados Unidos el debate se centraba en la procedencia de los datos, en Europa emergía otra preocupación: qué ocurre cuando los modelos de IA reproducen literalmente obras protegidas.

El pasado noviembre, un tribunal regional de Múnich dictó una sentencia histórica en el caso promovido por GEMA, la sociedad de gestión de derechos musicales alemana, contra OpenAI.

El tribunal alemán concluyó que los modelos de lenguaje de OpenAI habían memorizado letras de canciones protegidas de autores populares alemanes en sus parámetros internos. Cuando el sistema reproducía esas letras completas o fragmentos sustanciales en respuesta a consultas de usuarios, eso constituía una reproducción ilícita en términos de derecho de autor.

La sentencia rechazó expresamente que la excepción europea de minería de textos y datos (TDM, por sus siglas en inglés) ampare la memorización persistente de obras en modelos comerciales de IA.

Este fallo introduce el concepto de plagio técnico y establece que la mera disponibilidad pública de contenidos en internet no legitima su uso para entrenar sistemas de inteligencia artificial.

Según la resolución judicial, las empresas deben garantizar trazabilidad sobre el origen de sus datos, implementar auditorías y, en última instancia, obtener licencias o establecer mecanismos de compensación. El precedente marca una diferencia sustancial con la interpretación estadounidense del fair use y anticipa un marco regulatorio más estricto en territorio europeo.

El periodismo: demandas contra Perplexity y la investigación a Google

El conflicto no se limita a libros y música. El sector periodístico se ha convertido en otro frente de esta batalla.

La semana pasada, The New York Times interpuso una demanda federal en Nueva York contra Perplexity. El periódico acusa a la compañía de copiar ilegalmente millones de artículos, incluidos contenidos de pago, y de reconstruirlos sin autorización en sus respuestas generadas por inteligencia artificial.

Según The New York Times, Perplexity no solo utiliza sus reportajes como fuente de entrenamiento, sino que reproduce directamente sus trabajos, vulnerando tanto los derechos de autor como la integridad periodística de la marca.

El Chicago Tribune y otros medios estadounidenses (además de algunos japoneses) han presentado demandas similares, argumentando que el uso no autorizado de contenido informativo amenaza su modelo económico y desincentiva la producción de periodismo de calidad.

Esta misma semana, la Comisión Europea abrió una investigación antimonopolio contra Google (Alphabet) para determinar si la compañía utilizó contenidos de editores web y vídeos de YouTube para entrenar sus sistemas de IA sin compensar a los creadores ni ofrecerles posibilidad de rechazar ese uso.

La preocupación de Bruselas no es únicamente sobre copyright: también se trata de monopolio y competencia, pues Google podría estar otorgándose ventajas estructurales al negar a empresas rivales el acceso a esos contenidos.

Meta: de las demandas a los acuerdos

Meta Platforms no se ha librado de estas polémicas. En marzo de 2025, una coalición de editores y autores franceses (representados por las organizaciones SNE, SNAC y SGDL) presentó una demanda en París acusando a Meta de usar obras protegidas sin licencia para entrenar sus modelos de IA generativa, incluida la familia Llama.

Y, el pasado noviembre, la editorial Entrepreneur Media denunció a Meta ante un tribunal federal estadounidense por supuestamente utilizar sin permiso artículos de revistas de negocios y formación para alimentar sus sistemas.

Sin embargo, Meta llevó a cabo un llamativo giro estratégico. Este mismo mes de diciembre ha firmado acuerdos de licencia con medios como CNN, Fox News, USA Today y Le Monde para permitir un uso "legal y compensado" de sus contenidos en las herramientas de IA de Meta.

Este cambio de enfoque marca una nueva tendencia: reconocer explícitamente la necesidad de mantener los derechos de autor y retribuir a quienes producen la información.

Sin salir de la compañía que dirige Mark Zuckerberg, el pasado junio un juez federal de EEUU desestimó una demanda de 13 autores contra Meta que acusaban a la compañía de usar sus libros para entrenar sus modelos de lenguaje.

El magistrado consideró que, en ese caso concreto, el uso se acogía al fair use bajo la ley estadounidense. No obstante, la sentencia especificó que la decisión se limitaba solo a esos autores y no establecía un precedente absoluto, dejando la puerta abierta a futuras demandas si los autores aportan pruebas más contundentes del impacto económico.

Presión regulatoria y vacíos normativos en Europa

A pesar de la aprobación de la Ley de Inteligencia Artificial de la Unión Europea (AI Act), los colectivos de creadores han manifestado su preocupación por lo que consideran vacíos normativos importantes.

Organizaciones como ECSA (Coalición Europea de Compositores y Autores) y GESAC (Sociedad Europea de Autores y Compositores) denunciaron que la normativa no protege suficientemente los derechos de autor cuando las obras han sido utilizadas antes de la entrada en vigor de las nuevas regulaciones. En la práctica, esto significa que muchas creaciones pueden haber sido ya explotadas sin licencia, sin posibilidad real de compensación retroactiva.

No sólo en EEUU y Europa se actúa contra estos vacíos legales. En India, el Gobierno ha propuesto un marco que obligaría a las compañías de IA a pagar royalties por usar en sus entrenamientos contenidos protegidos localmente.

Todo esto parece trazar un rumbo claro: desde los datos públicos gratuitos hacia marcos donde debe haber consentimiento, compensación o, al menos, reglas claras sobre el uso de propiedad intelectual.

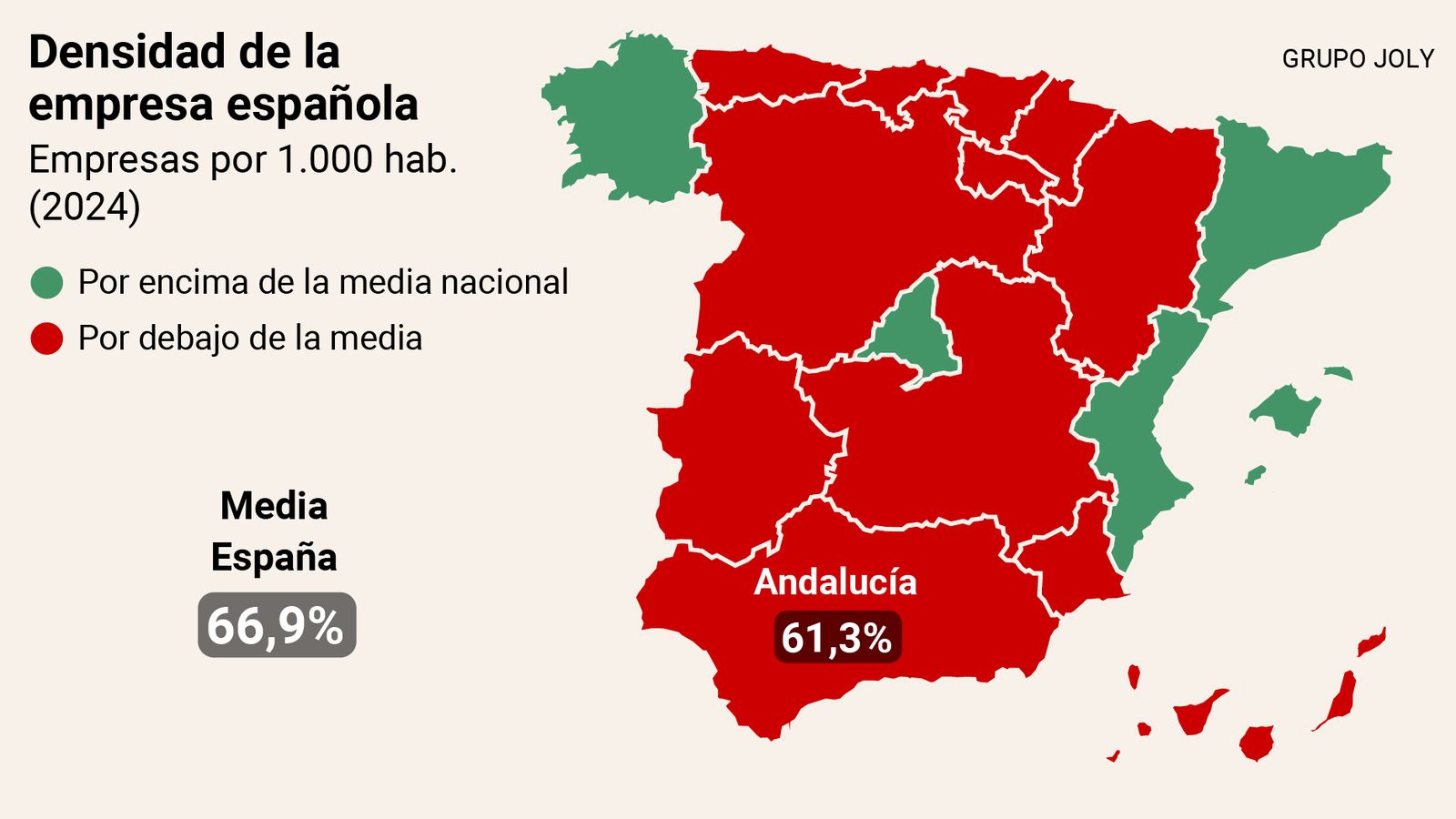

Implicaciones para España y el periodismo español

Aunque la mayoría de los litigios se han producido en Estados Unidos y Alemania, las repercusiones para España son directas.

El precedente de Múnich anticipa un entorno regulatorio europeo más estricto que afectará a empresas que operen en territorio español, tanto grandes tecnológicas como startups nacionales, que deberán demostrar con mayor claridad la procedencia lícita de los datos empleados en el entrenamiento de modelos.

Para el periodismo español, las consecuencias son particularmente relevantes. Durante los últimos meses, varias cabeceras españolas han denunciado que modelos de IA reproducen literalmente fragmentos de noticias, reportajes y análisis sin atribución ni licencia.

Si la memorización y reproducción de letras de canciones constituye una infracción según la jurisprudencia europea, el mismo razonamiento puede aplicarse a textos periodísticos.

Eso podría tanto acelerar la firma de acuerdos de licencia entre medios españoles y compañías de IA (siguiendo alcanzados en otros mercados), como impulsar acciones legales coordinadas si las negociaciones no prosperan.

Un cambio de paradigma inevitable

El conjunto de conflictos legales, comerciales y regulatorios que ha marcado 2025 (y que probablemente continuará en 2026) evidencia que la era de la inteligencia artificial ya no puede concebirse bajo la premisa de que cualquier dato disponible en internet es gratuito y puede emplearse para entrenar modelos.

Para la prensa, el cine, la música, la literatura y otras industrias culturales, este momento propicia una oportunidad de reivindicación: sus contenidos tienen valor y debe reconocerse mediante licencias, compensaciones y mecanismos de control.

Y, para las empresas de IA, el mensaje es que deben incorporar el respeto a los derechos de propiedad intelectual desde el diseño de sus sistemas, no como una corrección a posteriori.

También te puede interesar

Lo último